はじめに

WSL2 に CUDA Toolkit を導入できたら、次はディープラーニングの定番フレームワーク PyTorch をインストールしましょう。 WSL2 環境では、通常の Linux インストールと同じ手順で進められますが、「CUDA バージョンに合ったバイナリを指定する」 ことが、GPU を正しく認識させるためのポイントです。

WSLにcudaを認識させる方法→ WSL2 CUDA 構成方法【2026年版】

手順 1:PyTorch のインストール

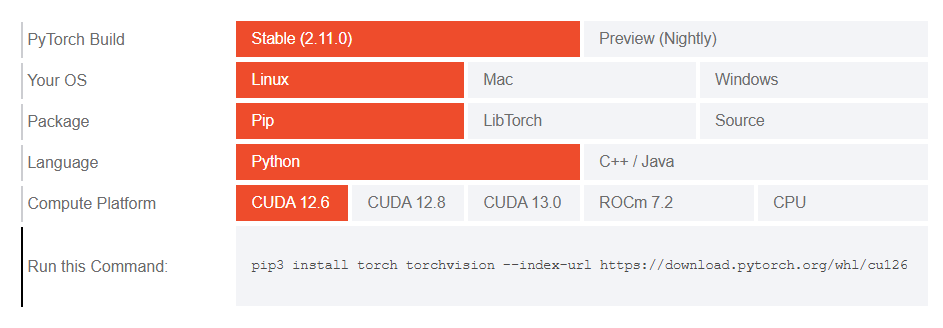

PyTorch 公式サイトのコマンド生成ツールを使い、自分の環境に最適なコマンドを発行します。

- PyTorch 公式サイト (pytorch.org) にアクセスします。

- 以下の項目を選択します。

- Build: Stable (最新版)

- OS: Linux

- Package: Pip (または Conda)

- Language: Python

- Compute Platform: CUDA 12.x / 13.x (導入した

nvcc -Vのバージョンに合わせる)

- 表示されたコマンドを WSL のターミナルで実行します。

実行コマンド例 (2026年最新構成の場合):

pip3 install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu130※

--index-urlを指定することで、CPU 版ではなく CUDA 版を確実にインストールします。

画像 : cuda install page 一番下に実行コマンドが表示されるのでコピペで導入できます。

手順 2:Python インタプリタでの起動確認

インストールが完了したら、実際に Python から GPU が見えるかテストします。

- ターミナルで

python3を起動します。 - 以下のコードを一行ずつ入力してください。

import torch

# 1. CUDAが利用可能か確認 (Trueなら成功)

print(torch.cuda.is_available())

# 2. 認識しているGPU名を表示

if torch.cuda.is_available():

print(torch.cuda.get_device_name(0))

else:

print("GPUが認識されていません")

# 3. 実際にテンソルを作成してGPUに送ってみる

x = torch.ones(3, 3).to("cuda")

print(x)成功時の出力イメージ:

True

NVIDIA GeForce RTX 4090

tensor([[1., 1., 1.],

[1., 1., 1.],

[1., 1., 1.]], device='cuda:0')device='cuda:0' と表示されれば、演算が正常に GPU 上で行われています!

よくあるトラブル:False と表示される場合

もし torch.cuda.is_available() が False になる場合は、以下をチェックしてください。

環境変数の不足: 前回の記事で設定した .bashrc のパスが反映されているか、source ~/.bashrc を試してください。

ドライバの不一致: Windows 側の NVIDIA ドライバが古すぎないか?(nvidia-smi が動くなら基本 OK)

CPU版の混入: 以前に pip install torch だけでインストールしたことがあると、(超ごくまれに)CPU 版が優先されることがあります。一度 pip uninstall torch してから手順 1 をやり直してください。

まとめと次の一歩

これで WSL2 上で PyTorch + GPU の環境が整いました。 次は、適当な深層学習モデルをgithubからとってきて動かしてみたり、nvitop あるいはnvidia-smiで GPU 負荷をリアルタイム監視したりするのがおすすめです!

ここまで読んでいただきありがとうございます。

では、次の記事で。 lumenHero